現代 AI 是這麼做出來的 - 從訓練、演算法到微調全實作

梁楠 著

- 出版商: 深智

- 出版日期: 2025-11-19

- 定價: $880

- 售價: 7.9 折 $695

- 語言: 繁體中文

- 頁數: 416

- ISBN: 6267757501

- ISBN-13: 9786267757505

-

相關分類:

DeepLearning

- 此書翻譯自: 從零構建大模型:算法、訓練與微調

立即出貨 (庫存 > 10)

買這商品的人也買了...

-

穿越作業系統迷霧:從零實現作業系統

穿越作業系統迷霧:從零實現作業系統$594$564 -

新範式來臨 - 用 PyTorch 了解 LLM 開發微調 ChatGLM 全過程

新範式來臨 - 用 PyTorch 了解 LLM 開發微調 ChatGLM 全過程$980$774 -

LLM 走進你的電腦 - 自己動手開發大型語言模型應用

LLM 走進你的電腦 - 自己動手開發大型語言模型應用$880$695 -

多 Agent 智慧體 - LangChain 大型 ReAct 系統開發

多 Agent 智慧體 - LangChain 大型 ReAct 系統開發$880$695 -

開源閉源 LLM 應用 - 從微調到 RAG、Agent 完整開發實作

開源閉源 LLM 應用 - 從微調到 RAG、Agent 完整開發實作$880$695 -

全面掌握 DeepSeek - LLM 微調、生成式 AI、企業級應用開發

全面掌握 DeepSeek - LLM 微調、生成式 AI、企業級應用開發$600$420 -

深度學習最佳入門與專題實戰:理論基礎與影像篇

深度學習最佳入門與專題實戰:理論基礎與影像篇$980$774 -

AI Vision × LLM 電腦視覺應用聖經:OpenCV × YOLO × Ollama 解鎖多模態全攻略

AI Vision × LLM 電腦視覺應用聖經:OpenCV × YOLO × Ollama 解鎖多模態全攻略$880$695 -

從資料處理到圖論實踐 ― 用 Python 及 AI 最強工具預測分析

從資料處理到圖論實踐 ― 用 Python 及 AI 最強工具預測分析$1,280$1,011 -

Ollama 本地 AI 全方位攻略:命令列功能、五大主題測試、RAG、Vibe Coding、MCP,一本搞定所有實戰應用

Ollama 本地 AI 全方位攻略:命令列功能、五大主題測試、RAG、Vibe Coding、MCP,一本搞定所有實戰應用$750$592 -

完整複習 NLP - 圍繞 LLM 打造自然語言處理應用

完整複習 NLP - 圍繞 LLM 打造自然語言處理應用$1,080$853 -

實用 DeepSeek 技術 - 開發真正可用的 LLM 應用程式

實用 DeepSeek 技術 - 開發真正可用的 LLM 應用程式$880$695 -

比 RAG 更強 - 知識增強 LLM 型應用程式實戰

比 RAG 更強 - 知識增強 LLM 型應用程式實戰$980$774 -

LLM 開源大物 - DeepSeek 深入技術多模態開發

LLM 開源大物 - DeepSeek 深入技術多模態開發$980$774 -

手把手帶你實作完整機器學習專案

手把手帶你實作完整機器學習專案$760$600 -

Vibe Coding CLI 頂級開發 - Claude Code 前瞻菁英育成手冊

Vibe Coding CLI 頂級開發 - Claude Code 前瞻菁英育成手冊$1,080$853 -

生成式 AI 開發實作|使用 Transformers 與擴散模型 (Hands-On Generative AI with Transformers and Diffusion Models)

生成式 AI 開發實作|使用 Transformers 與擴散模型 (Hands-On Generative AI with Transformers and Diffusion Models)$980$774 -

LLM 應用開發 - 業界最實用 30個應用現場直擊

LLM 應用開發 - 業界最實用 30個應用現場直擊$920$726 -

LLM × 網路爬蟲終極實戰:n8n 串接資料爬取 × Qdrant × RAG 打造本機 AI Agent

LLM × 網路爬蟲終極實戰:n8n 串接資料爬取 × Qdrant × RAG 打造本機 AI Agent$980$774 -

Grafana Zero to Hero:從視覺化到智慧監控,打造全知視角的可觀測性平台(iThome鐵人賽系列書)

Grafana Zero to Hero:從視覺化到智慧監控,打造全知視角的可觀測性平台(iThome鐵人賽系列書)$720$561 -

白話人工智慧!矽谷科學家帶你看懂 AI 黑科技

白話人工智慧!矽谷科學家帶你看懂 AI 黑科技$560$442 -

迎戰 APCS!C++ 從零開始的 PBL 實戰學習法

迎戰 APCS!C++ 從零開始的 PBL 實戰學習法$760$600 -

更少 GPU 卻更強 - LLM 輕量化壓縮及加速訓練

更少 GPU 卻更強 - LLM 輕量化壓縮及加速訓練$980$774 -

史上最完整 -- 一本書晉升深度學習世界級大師

史上最完整 -- 一本書晉升深度學習世界級大師$1,280$1,011 -

使用 FastAPI 建構生成式AI服務|開發理解豐富脈絡的生成式 AI 應用 (Building Generative AI Services with Fastapi: A Practical Approach to Developing Context-Rich Generative AI Applications)

使用 FastAPI 建構生成式AI服務|開發理解豐富脈絡的生成式 AI 應用 (Building Generative AI Services with Fastapi: A Practical Approach to Developing Context-Rich Generative AI Applications)$880$695

相關主題

商品描述

【書籍特點】

☆Transformer:自注意力、多頭注意力、位置編碼

☆GPT:文字生成、Greedy Search、Beam Search、困惑度評估

☆BERT:遮罩語言模型、預訓練、微調、分類任務

☆ViT:影像分塊、視覺嵌入、注意力量化

☆微調方法:Adapter Tuning、LoRA、P-Tuning

☆資料處理:文字清洗、分詞、嵌入向量、資料增強

☆混合精度與分散式訓練:Data Parallel、Model Parallel、梯度累積

☆對比學習與對抗訓練:SimCLR、GAN、自監督任務

☆最佳化器:AdamW、LAMB、動態學習率、Warmup、餘弦退火

☆模型壓縮:知識蒸餾、教師學生架構、權重剪枝

☆訓練流程:Tokenization、多GPU訓練、訓練中斷與恢復

☆微調實作:資料集切分、層級凍結、超參數調整、推理量化

【內容簡介】

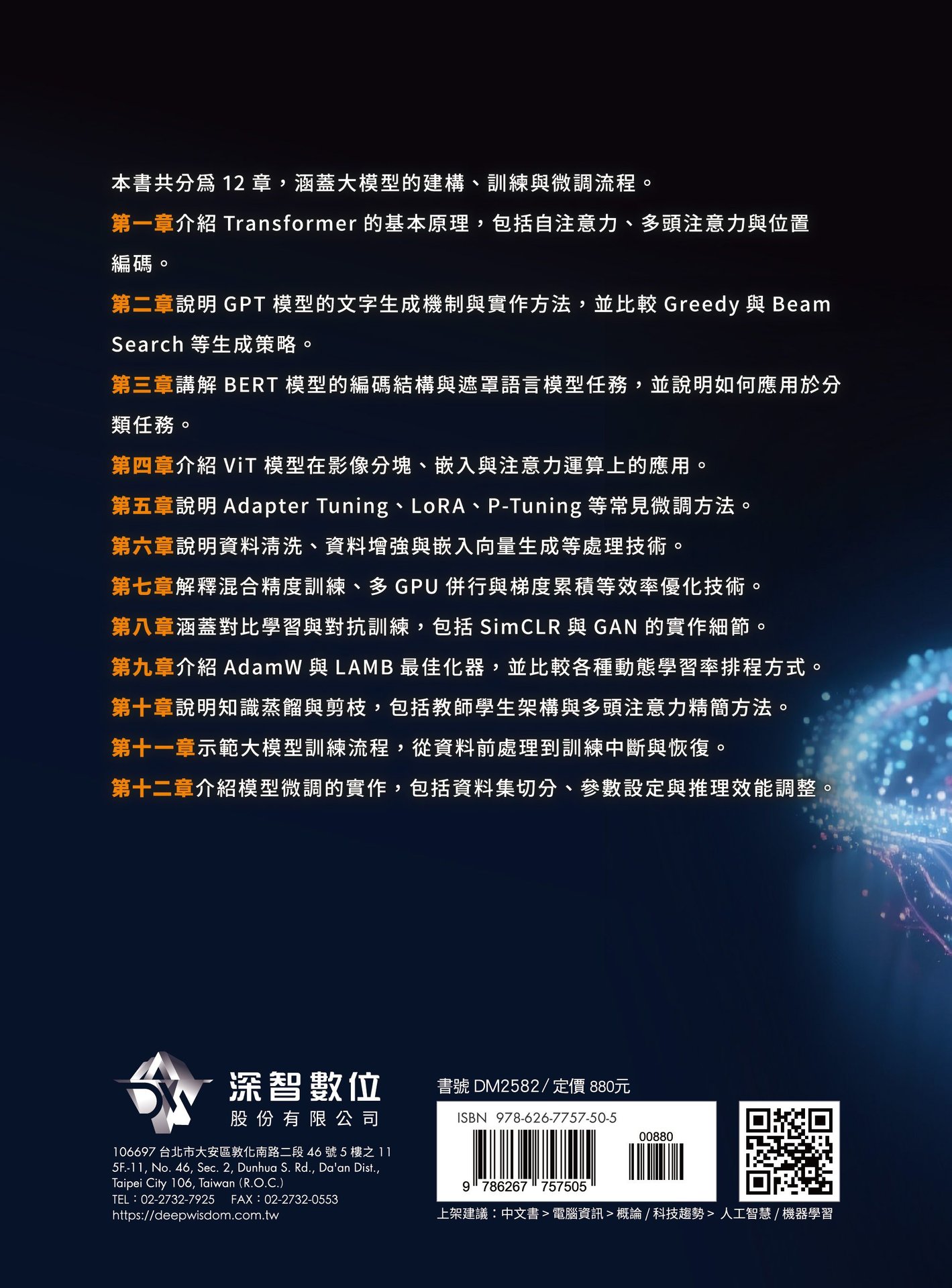

本書共分為12章,涵蓋大模型的建構、訓練與微調流程。

第一章介紹Transformer的基本原理,包括自注意力、多頭注意力與位置編碼。第二章說明GPT模型的文字生成機制與實作方法,並比較Greedy與Beam Search等生成策略。第三章講解BERT模型的編碼結構與遮罩語言模型任務,並說明如何應用於分類任務。第四章介紹ViT模型在影像分塊、嵌入與注意力運算上的應用。第五章說明Adapter Tuning、LoRA、P-Tuning等常見微調方法。第六章說明資料清洗、資料增強與嵌入向量生成等處理技術。第七章解釋混合精度訓練、多GPU併行與梯度累積等效率優化技術。第八章涵蓋對比學習與對抗訓練,包括SimCLR與GAN的實作細節。第九章介紹AdamW與LAMB最佳化器,並比較各種動態學習率排程方式。第十章說明知識蒸餾與剪枝,包括教師學生架構與多頭注意力精簡方法。第十一章示範大模型訓練流程,從資料前處理到訓練中斷與恢復。第十二章介紹模型微調的實作,包括資料集切分、參數設定與推理效能調整。作者簡介

梁楠 博士

畢業於北京航空航天大學,高級工程師,長期從事模式識別、機器學習、統計理論的研究與應用,負責或參與過多項科研項目,專註於人工智慧、大語言模型的應用與開發,對深度學習、數據分析與預測等有獨到見解。

目錄大綱

▌第0 章 引言

一、大模型技術的發展歷史

1. 基於規則和統計學習的早期階段

2. 神經網路與深度學習的崛起

3. Transformer 的誕生與自注意力機制的崛起

4. 預訓練模型的興起:BERT、GPT 和T5

5. 超大規模模型與多模態應用

二、開發環境配置基礎

1. 硬體規格要求

2. 軟體相依與環境架設

3. 常見問題與解決方案

▌第1 章 Transformer 模型基礎

1.1 Seq2Seq 模型

1.1.1 編碼器-解碼器工作原理

1.1.2 Seq2Seq 結構實現

1.2 分詞與嵌入層

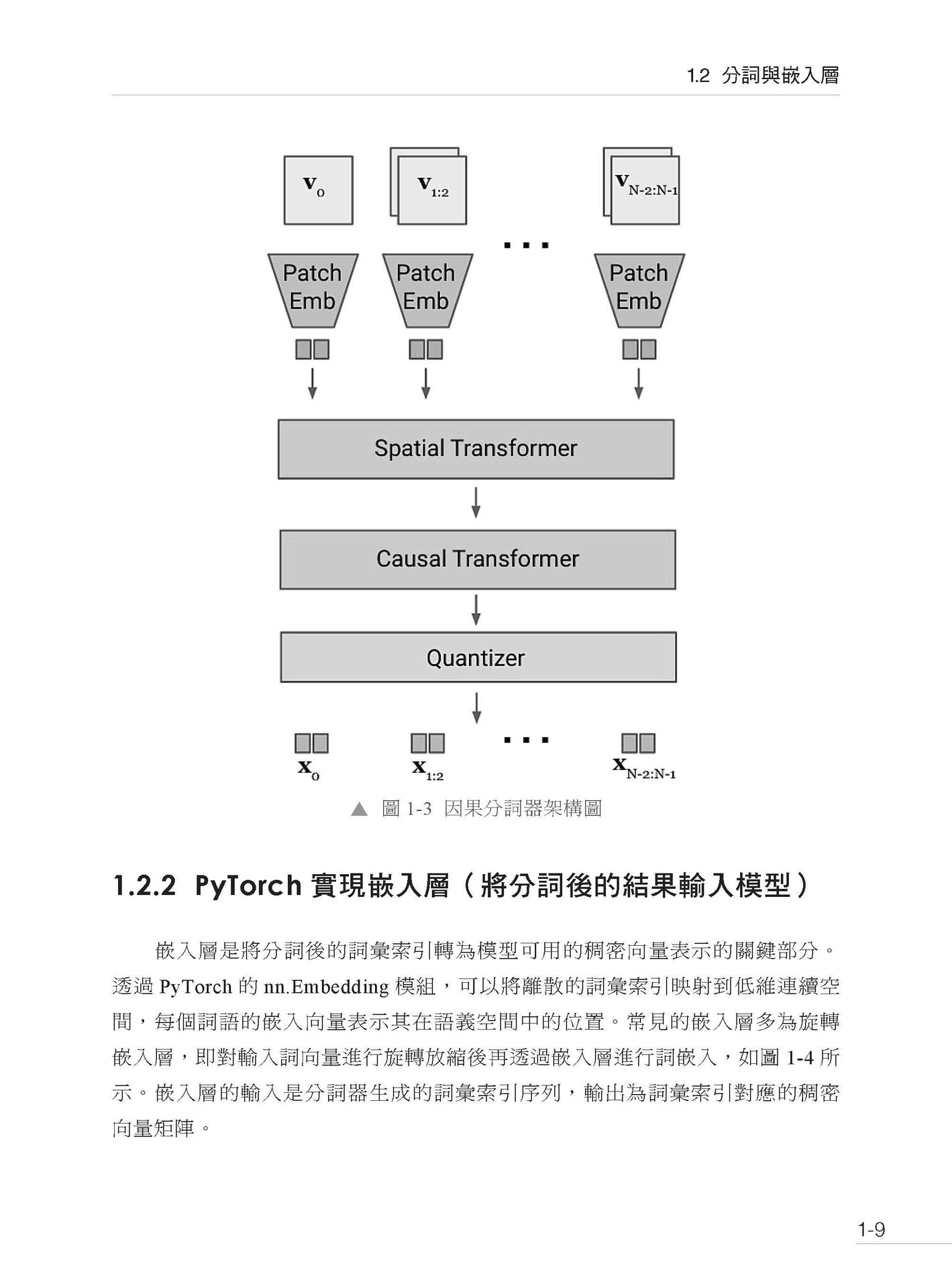

1.2.1 分詞器:將文字轉為嵌入向量

1.2.2 PyTorch 實現嵌入層(將分詞後的結果輸入模型)

1.3 自注意力與多頭注意力機制

1.3.1 自注意力機制計算過程(QKV 矩陣生成和點積運算)

1.3.2 多頭注意力機制與Transformer

1.4 殘差連接與層歸一化

1.4.1 殘差連接層的實現

1.4.2 層歸一化與訓練穩定性

1.5 位置編碼器

1.5.1 位置編碼的計算與實現

1.5.2 位置編碼在無序文本資料中的作用

1.6 本章小結

1.7 思考題

▌第2 章 GPT 模型文字生成核心原理與實現

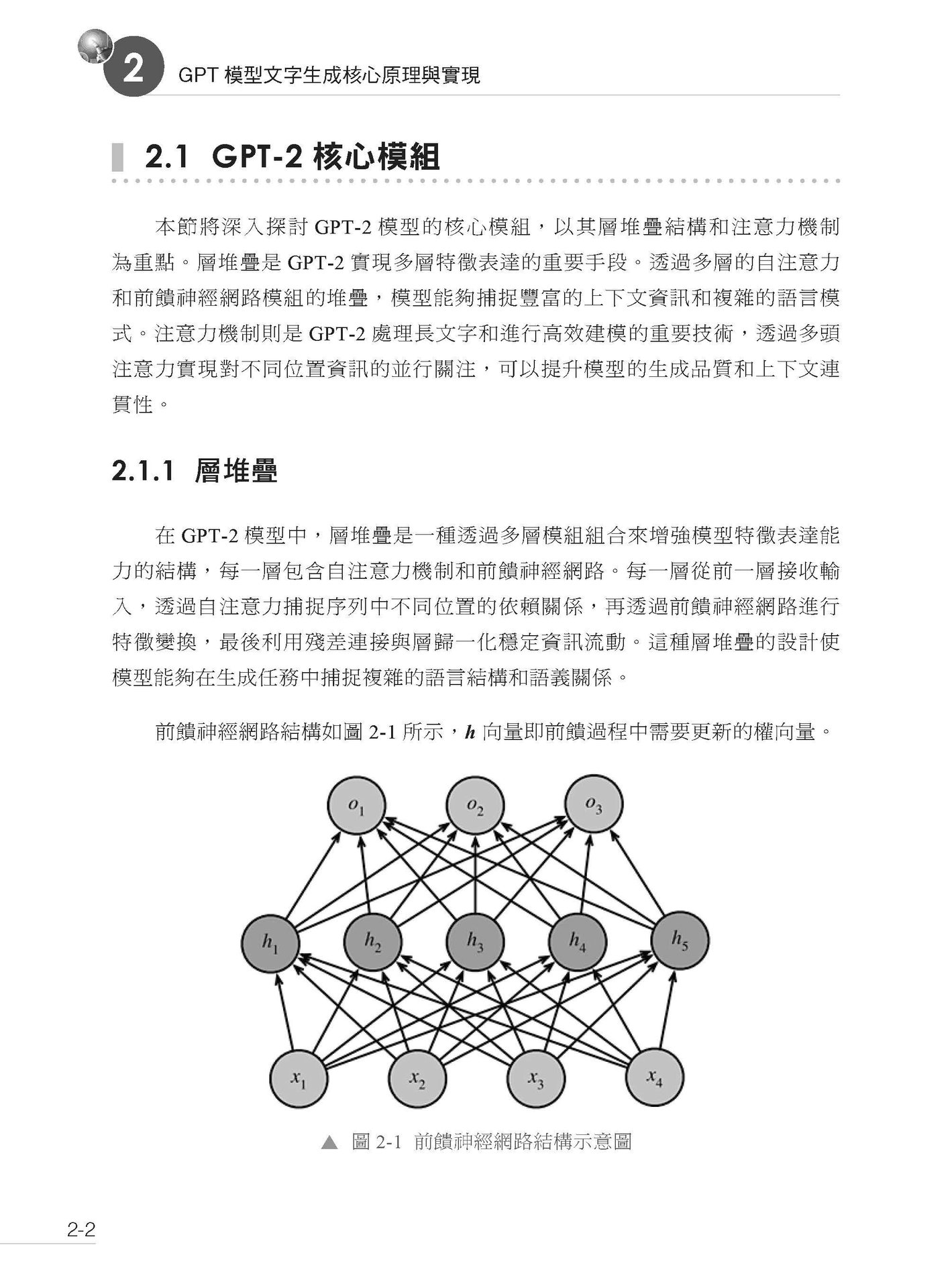

2.1 GPT-2 核心模組

2.1.1 層堆疊

2.1.2 GPT-2 中的注意力機制

2.2 GPT 模型的文字生成過程

2.2.1 詳解GPT-2 文字生成過程

2.2.2 Greedy Search 和Beam Search 演算法的實現與對比

2.3 模型效果評估與調優

2.3.1 模型常見評估方法

2.3.2 基於困惑度的評估過程

2.4 本章小結

2.5 思考題

▌第3 章 BERT 模型核心實現與預訓練

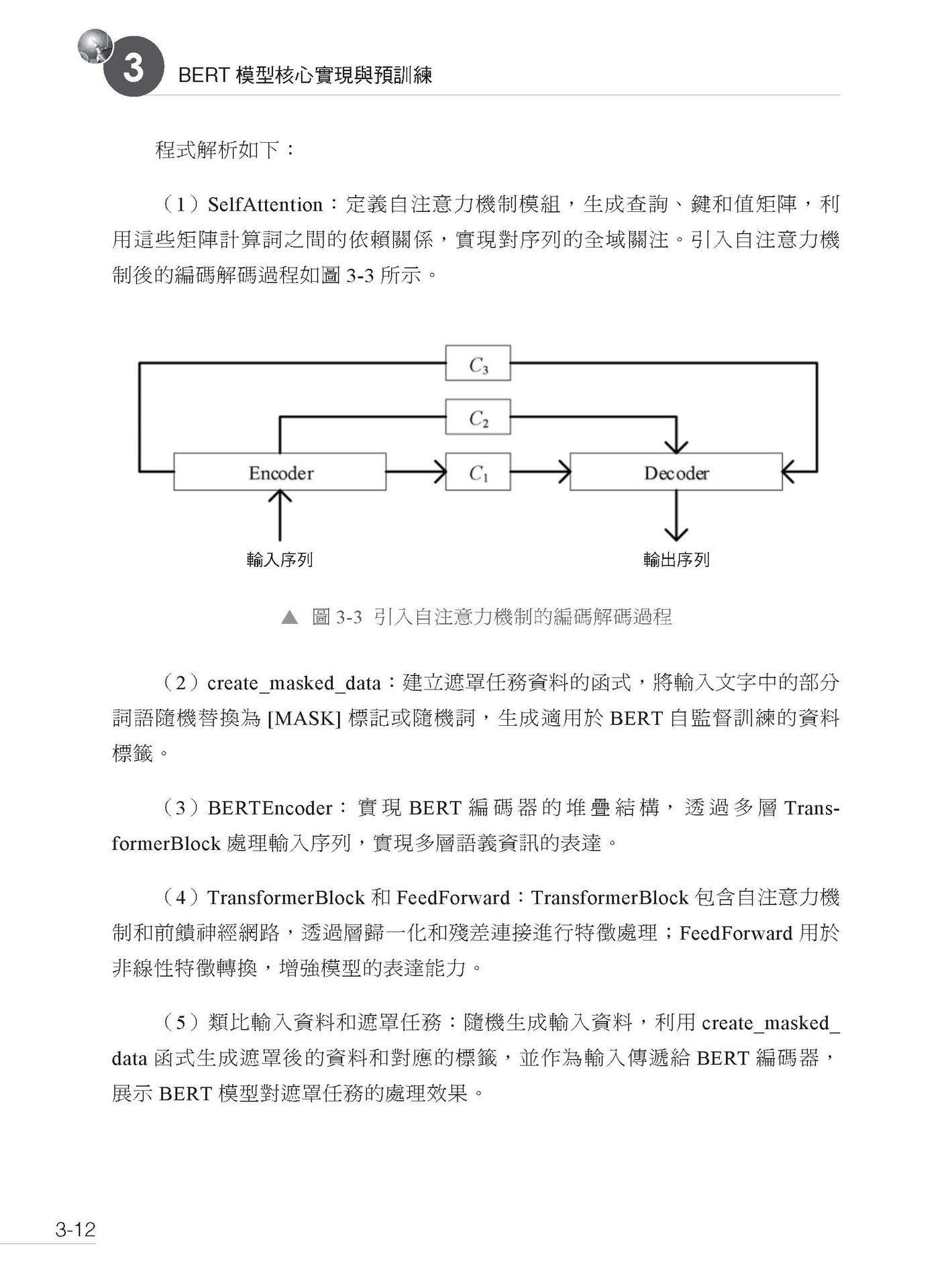

3.1 BERT 模型的核心實現

3.1.1 編碼器堆疊

3.1.2 BERT 的自注意力機制與遮罩任務

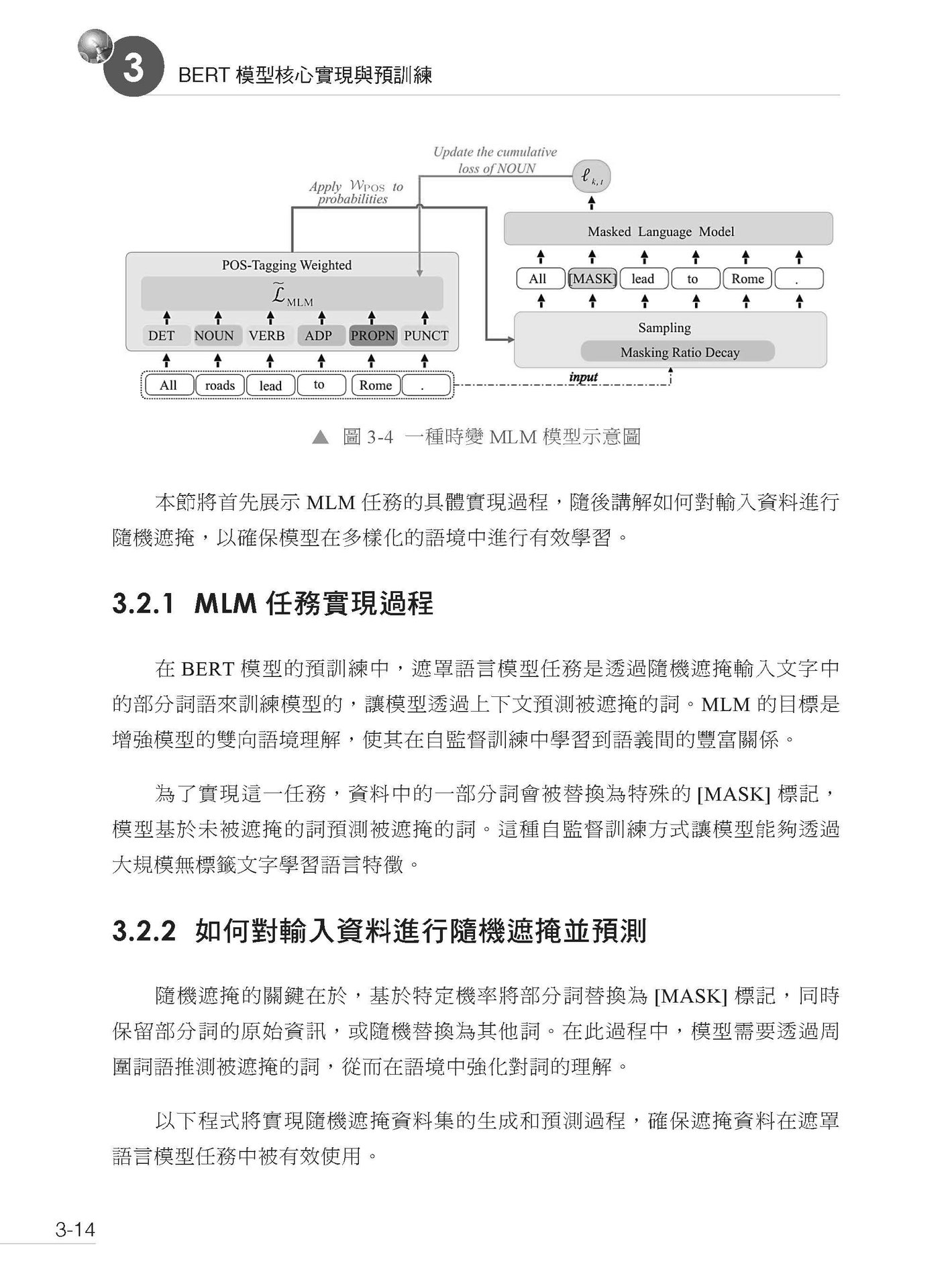

3.2 預訓練任務:遮罩語言模型(MLM)

3.2.1 MLM 任務實現過程

3.2.2 如何對輸入資料進行隨機遮掩並預測

3.3 BERT 模型的微調與分類任務應用

3.4 本章小結

3.5 思考題

▌第4 章 ViT 模型

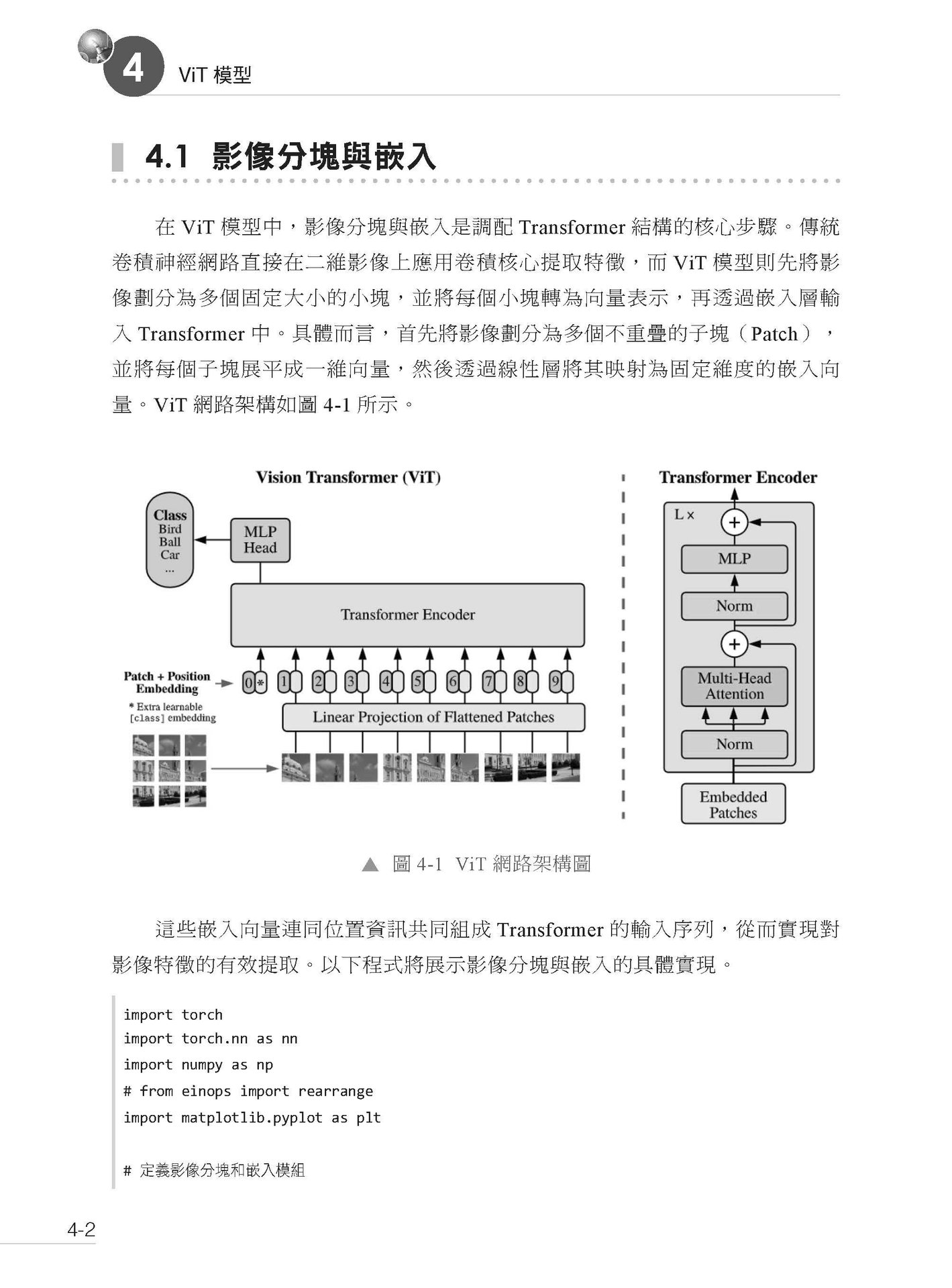

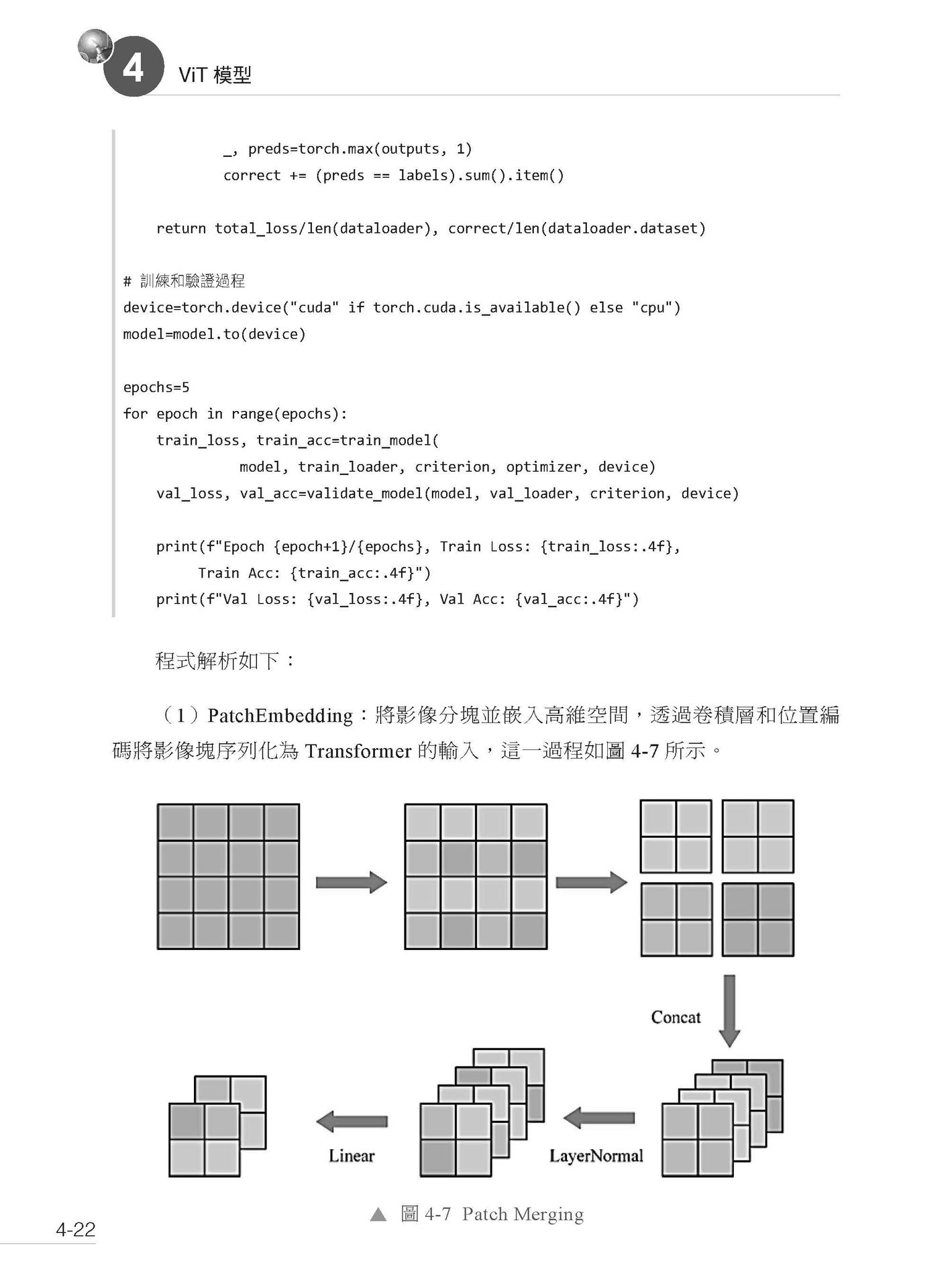

4.1 影像分塊與嵌入

4.2 ViT 模型的核心架構實現

4.2.1 ViT 模型的基礎結構

4.2.2 自注意力和多頭注意力在影像處理中的應用

4.3 訓練與評估ViT 模型

4.4 ViT 模型與注意力嚴格量化分析

4.5 本章小結

4.6 思考題

▌第5 章 高階微調策略:Adapter Tuning 與P-Tuning

5.1 Adapter Tuning 的實現

5.2 LoRA Tuning 實現

5.3 Prompt Tuning 與P-Tuning 的應用

5.3.1 Prompt Tuning

5.3.2 P-Tuning

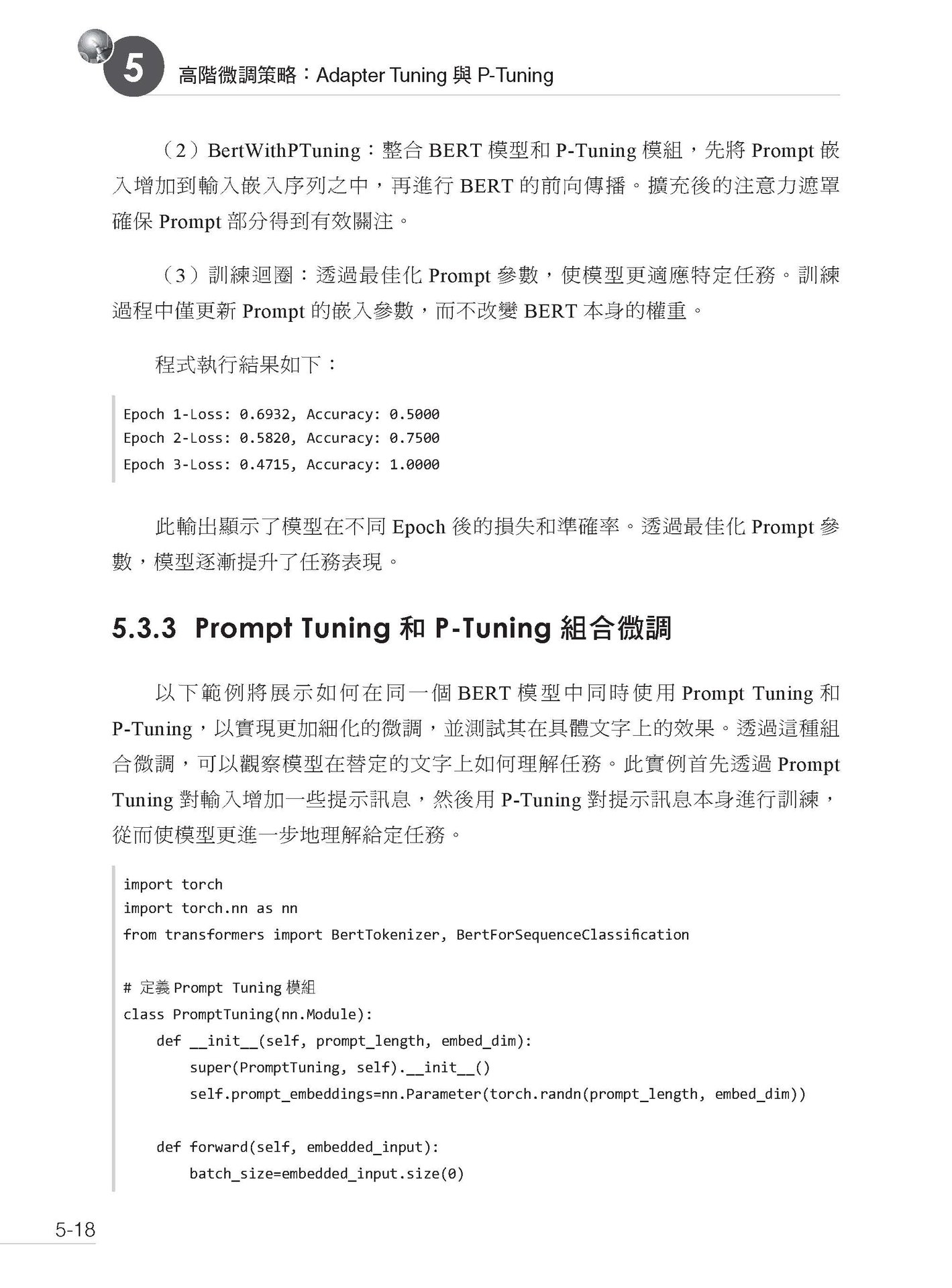

5.3.3 Prompt Tuning 和P-Tuning 組合微調

5.3.4 長文字情感分類模型的微調與驗證

5.4 本章小結

5.5 思考題

▌第6 章 資料處理與資料增強

6.1 資料前置處理與清洗

6.1.1 文字資料前置處理

6.1.2 文字資料清洗

6.2 文字資料增強

6.2.1 同義詞替換

6.2.2 隨機插入

6.2.3 其他類型的文字資料增強方法

6.3 分詞與嵌入層的應用

6.3.1 深度理解分詞技術

6.3.2 嵌入向量的生成與最佳化

6.3.3 文字前置處理與資料增強綜合案例

6.4 本章小結

6.5 思考題

▌第7 章 模型性能最佳化:混合精度訓練與分散式訓練

7.1 混合精度訓練的實現

7.2 多GPU 並行與分散式訓練的實現

7.2.1 分散式訓練流程與常規配置方案

7.2.2 Data Parallel 方案

7.2.3 Model Parallel 方案

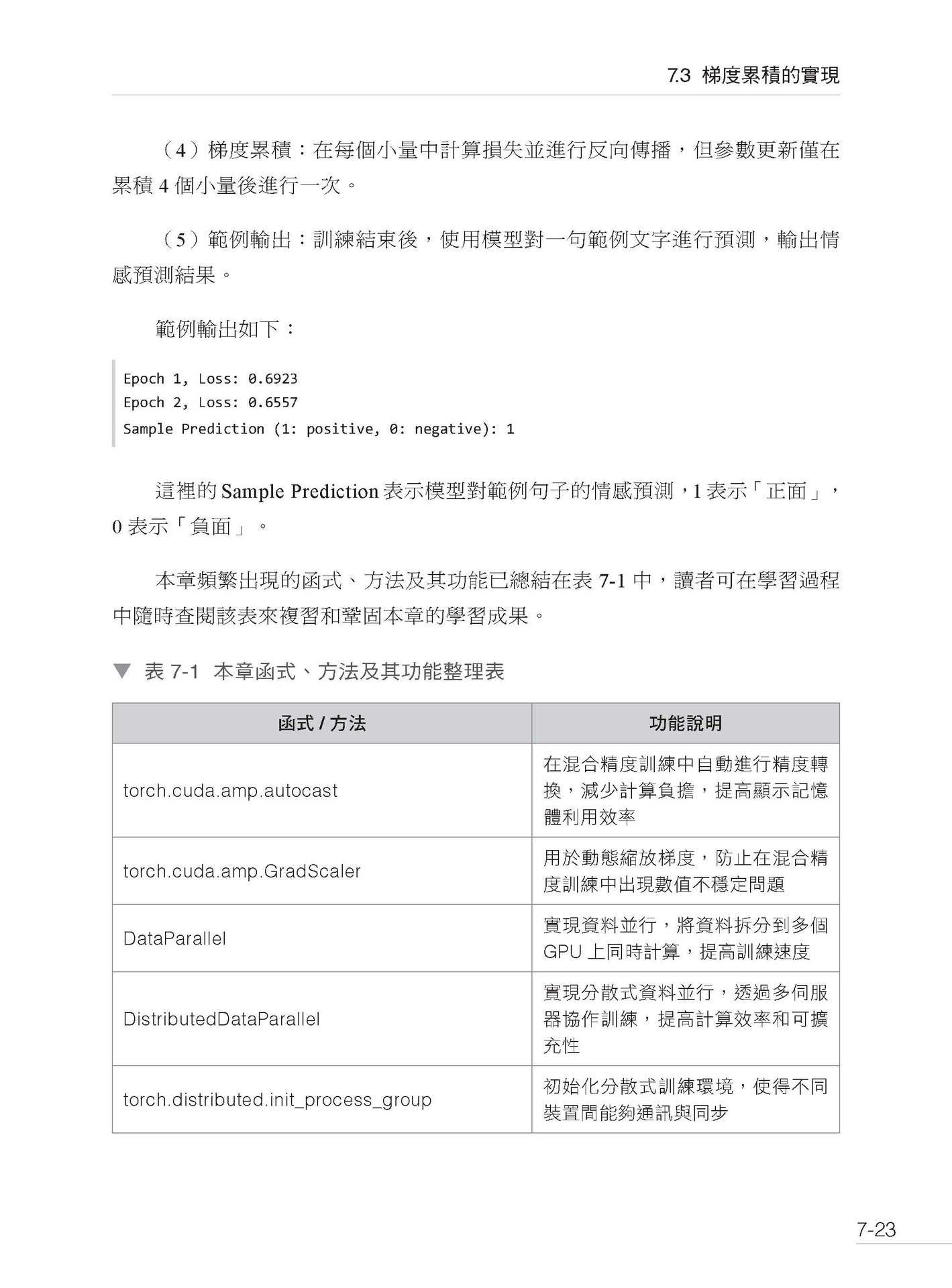

7.3 梯度累積的實現

7.3.1 梯度累積初步實現

7.3.2 小量訓練中的梯度累積

7.3.3 梯度累積處理文字分類任務

7.4 本章小結

7.5 思考題

▌第8 章 對比學習與對抗訓練

8.1 對比學習

8.1.1 建構正負樣本對及損失函式

8.1.2 SimCLR 的實現與初步應用

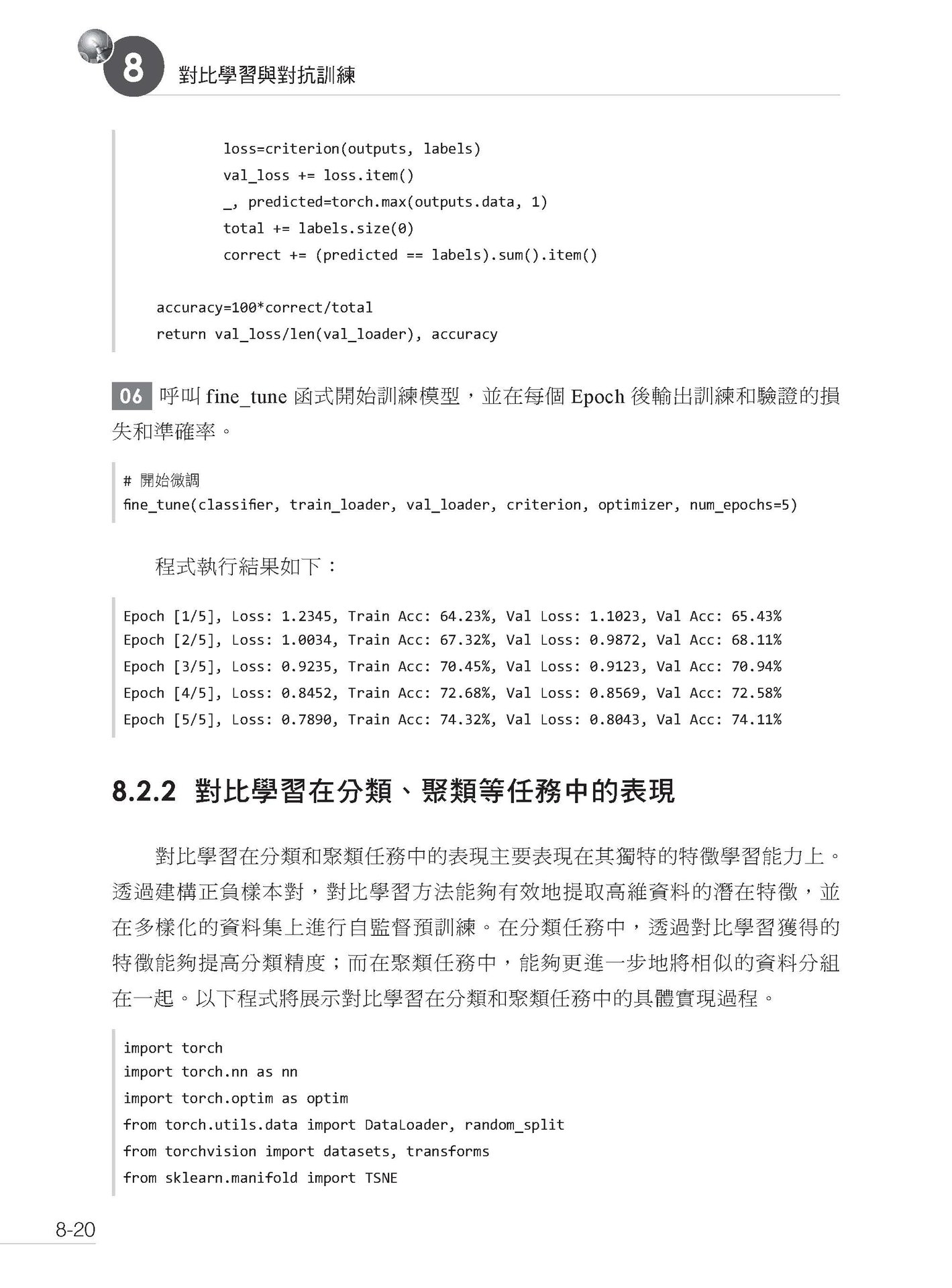

8.2 基於對比學習的預訓練與微調

8.2.1 透過對比學習進行自監督預訓練

8.2.2 對比學習在分類、聚類等任務中的表現

8.3 生成式對抗網路的實現與最佳化

8.4 對抗訓練在大模型中的應用

8.5 本章小結

8.6 思考題

▌第9 章 自我調整最佳化器與動態學習率排程

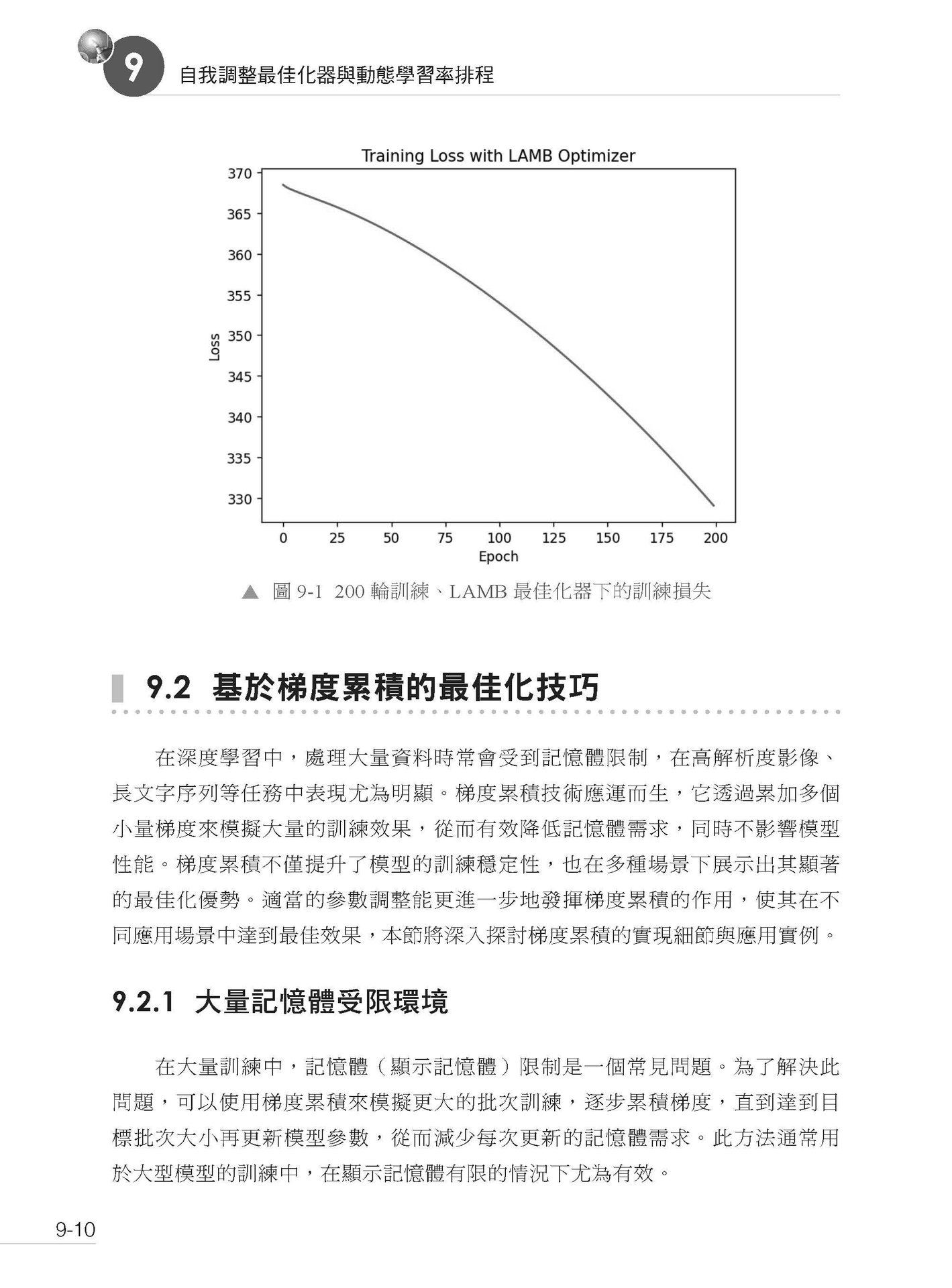

9.1 AdamW 最佳化器與LAMB 最佳化器的實現

9.1.1 AdamW 最佳化器

9.1.2 LAMB 最佳化器

9.2 基於梯度累積的最佳化技巧

9.2.1 大量記憶體受限環境

9.2.2 梯度累積的應用場景和參數調整對訓練效果的影響

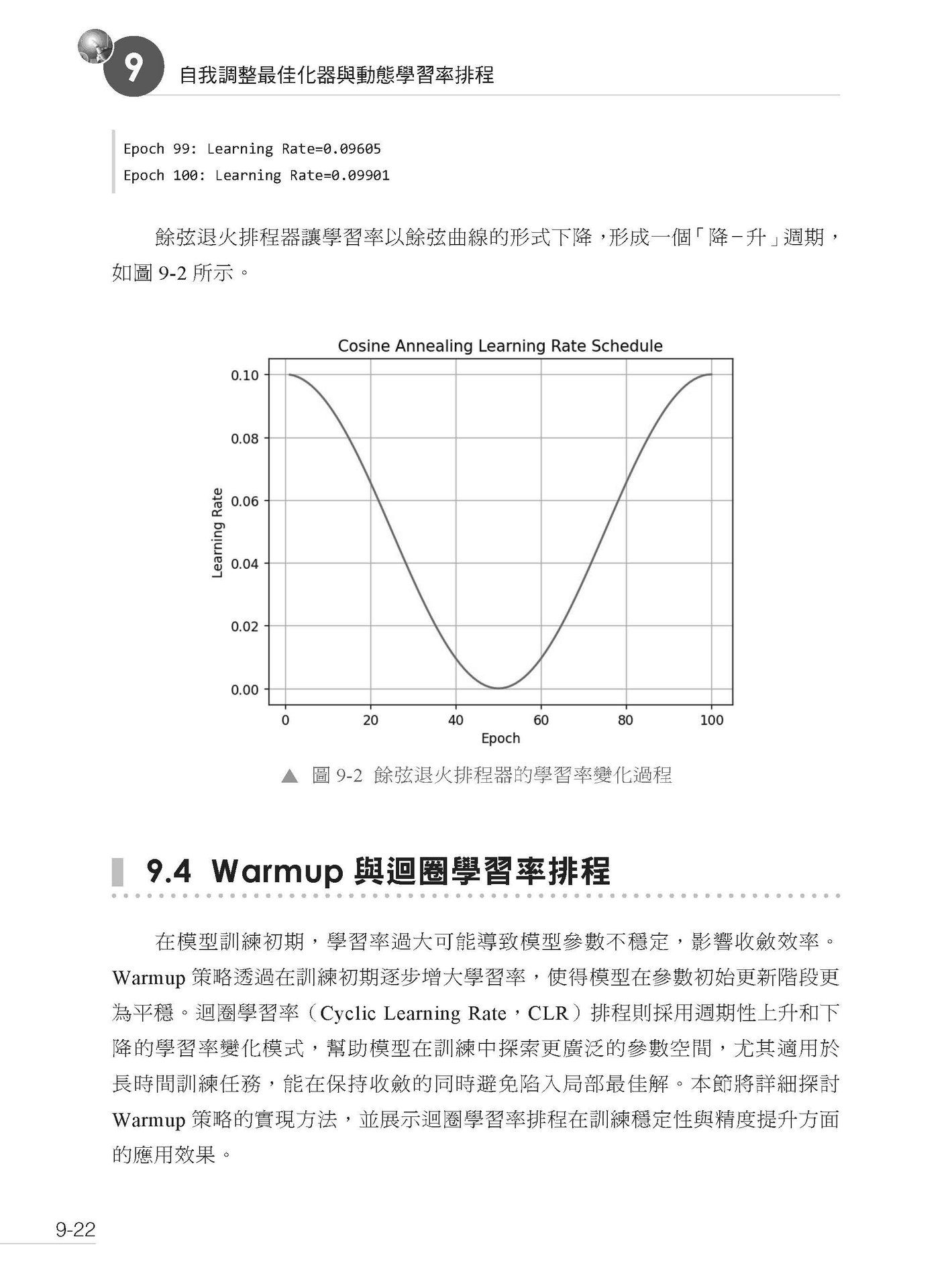

9.3 動態學習率排程

9.3.1 線性衰減

9.3.2 餘弦退火

9.4 Warmup 與迴圈學習率排程

9.4.1 Warmup 策略實現

9.4.2 迴圈學習率排程

9.4.3 其他幾種常見的動態學習排程器

9.5 本章小結

9.6 思考題

▌第10 章 模型蒸餾與剪枝

10.1 知識蒸餾:教師-學生模型

10.1.1 知識蒸餾核心過程

10.1.2 教師-學生模型

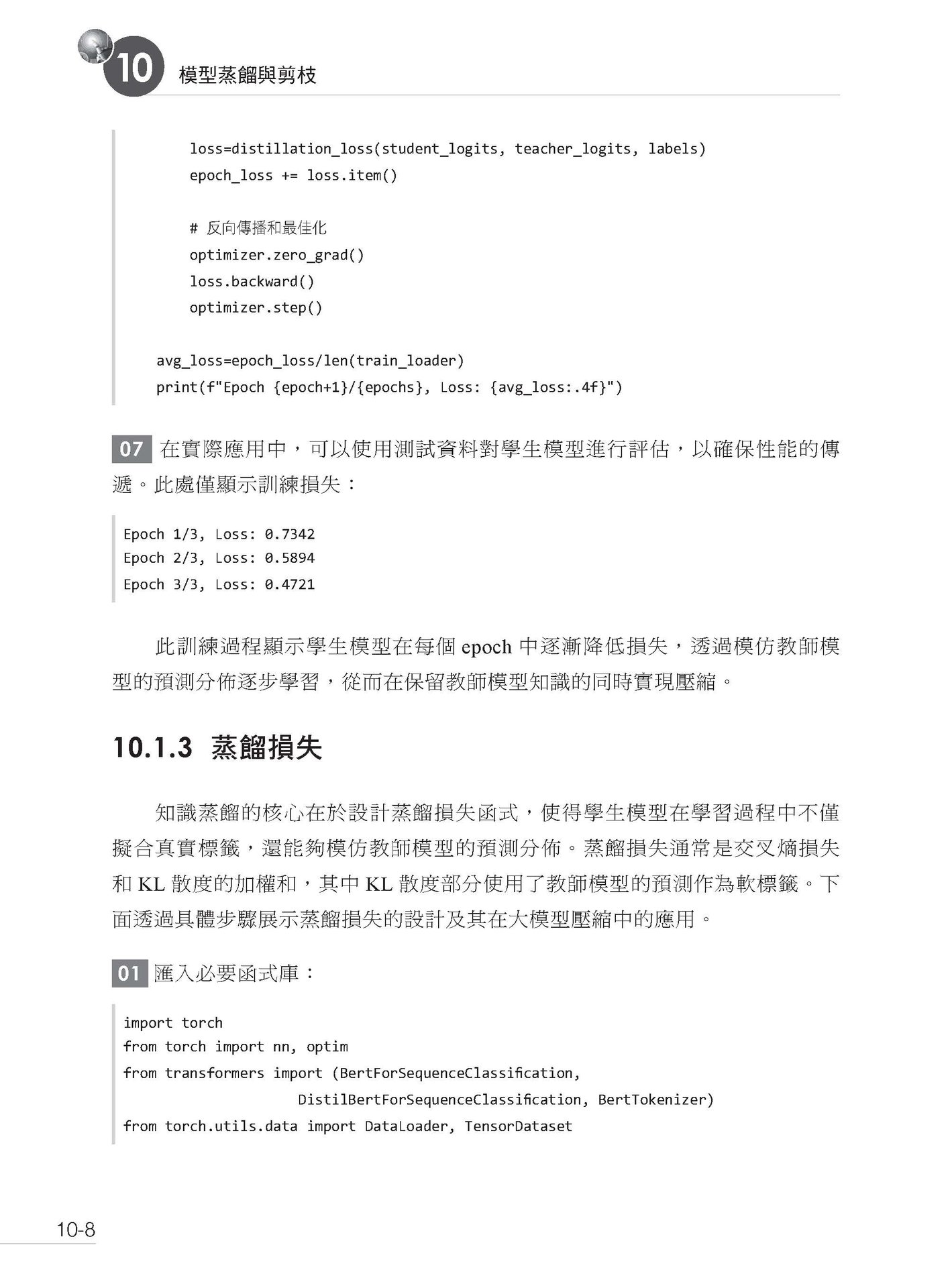

10.1.3 蒸餾損失

10.2 知識蒸餾在文字模型中的應用

10.2.1 知識蒸餾在文字分類模型中的應用

10.2.2 模型蒸餾效率分析

10.2.3 文字情感分析任務中的知識蒸餾效率對比

10.3 模型剪枝技術

10.3.1 權重剪枝

10.3.2 結構化剪枝

10.3.3 在嵌入式裝置上部署手寫數字辨識模型

10.3.4 BERT 模型的多頭注意力剪枝

10.4 本章小結

10.5 思考題

▌第11 章 模型訓練實戰

11.1 資料前置處理與Tokenization 細節

11.1.1 大規模文字資料清洗

11.1.2 常用分詞器的使用

11.2 大規模預訓練模型的設置與啟動

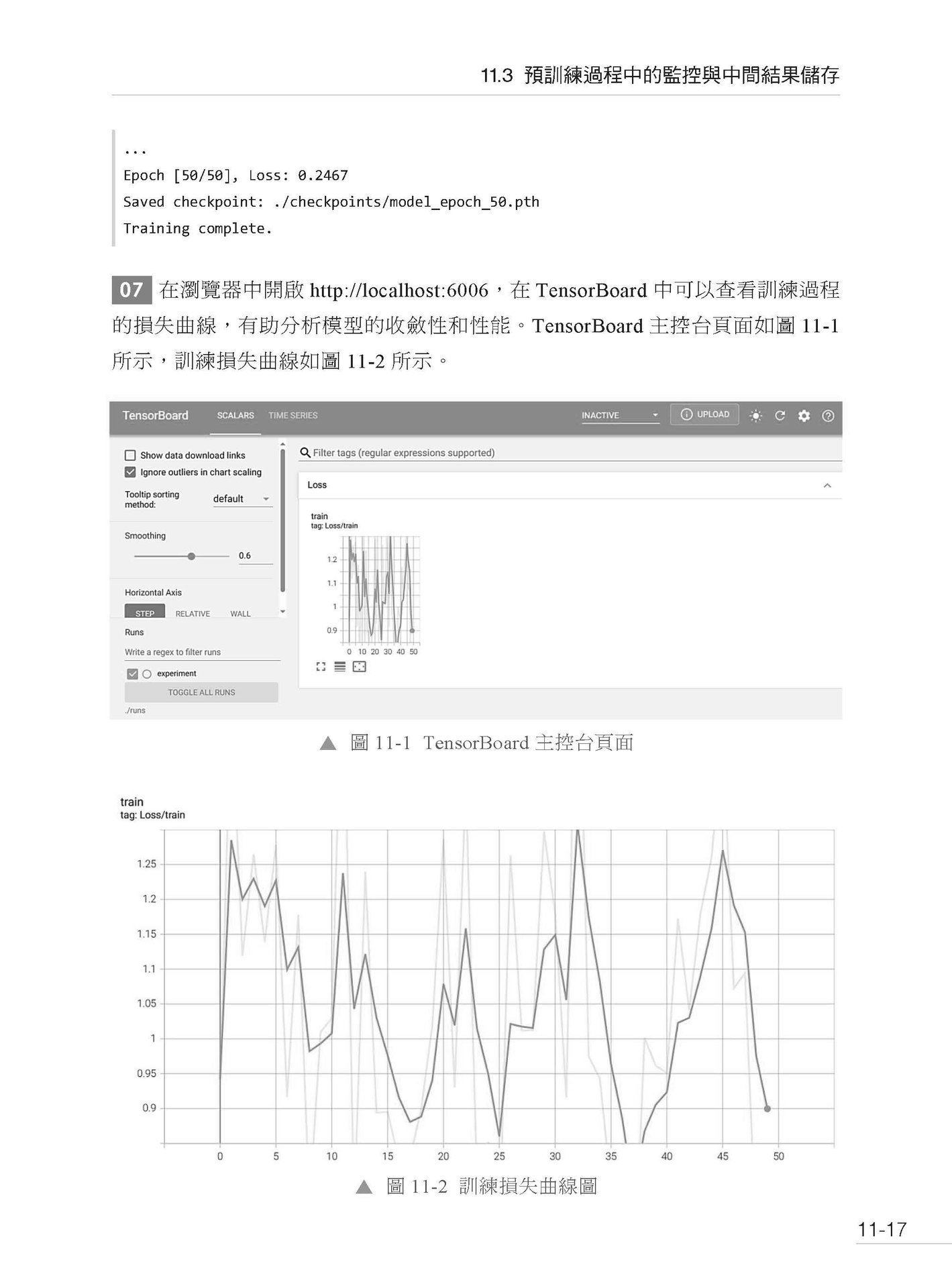

11.3 預訓練過程中的監控與中間結果儲存

11.4 訓練中斷與恢復機制

11.5 綜合案例:IMDB 文字分類訓練全流程

11.5.1 資料前置處理與Tokenization

11.5.2 多GPU 與分散式訓練設置

11.5.3 訓練過程中的監控與中間結果儲存

11.5.4 訓練中斷與恢復

11.5.5 測試模型性能

11.6 本章小結

11.7 思考題

▌第12 章 模型微調實戰

12.1 微調資料集的選擇與準備

12.1.1 資料集準備與清洗

12.1.2 資料集分割

12.1.3 資料增強

12.2 層級凍結與部分解凍策略

12.3 模型參數調整與最佳化技巧

12.4 微調後的模型評估與推理最佳化

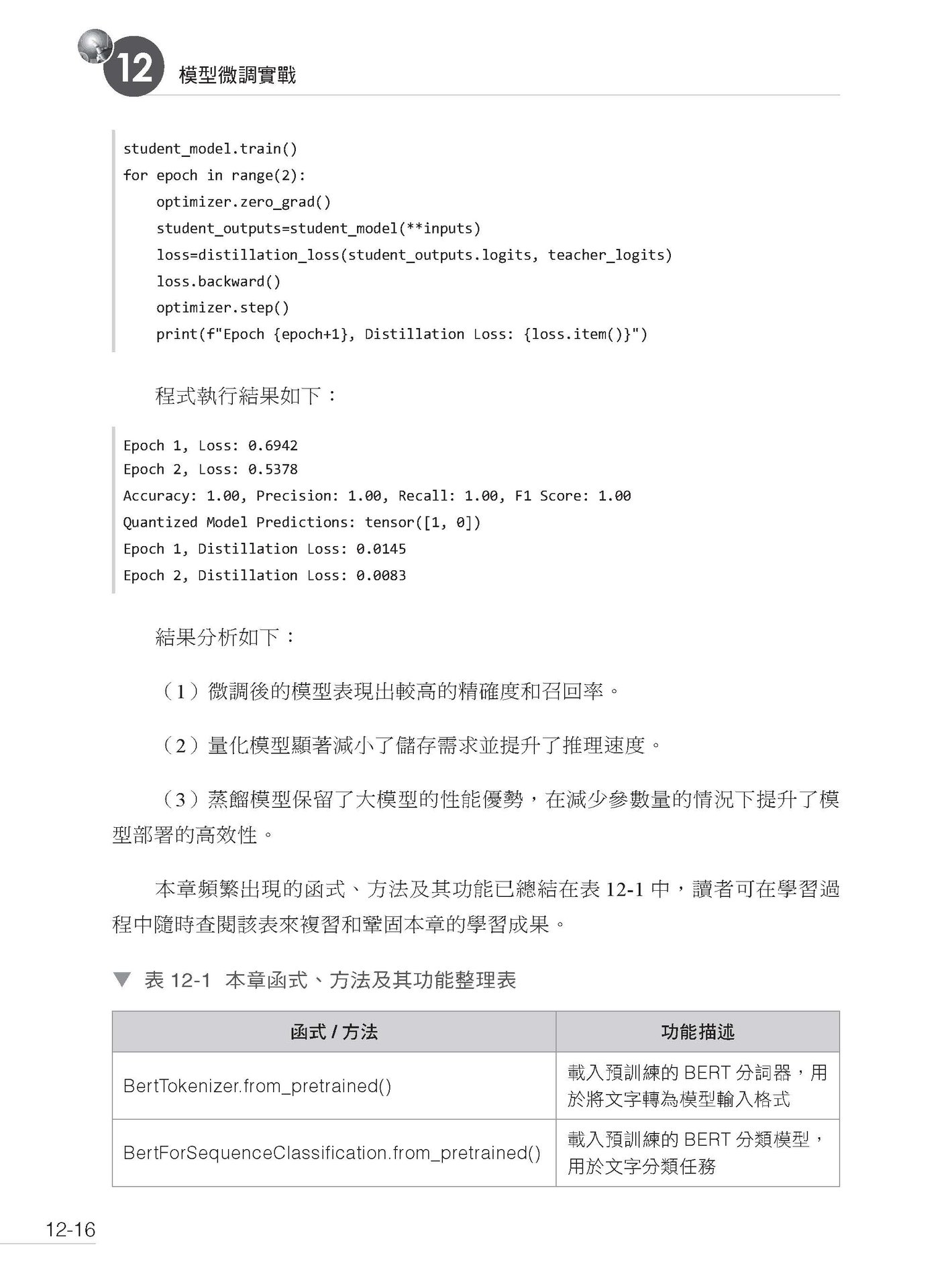

12.5 綜合微調應用案例

12.6 本章小結

12.7 思考題